AIエージェント開発、そのボトルネックはどこにある?

AIエージェント開発。なんだかワクワクする響きですが、実際にビジネスへ導入しようとすると、意外とハードルが高いと感じることはありませんか?「専門知識を持つ人材がいない」「初期投資が大きすぎる」「PoCで終わって、なかなか実用化まで進まない」。多くの企業が直面する課題です。本当に、AIエージェントは一部のトップ企業だけが扱える魔法の杖なのでしょうか?

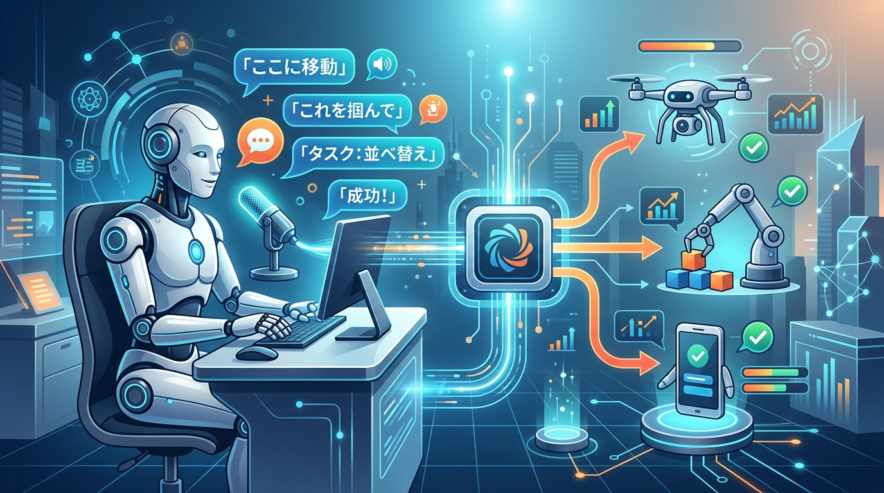

今回ご紹介するOpenClaw-RLは、そんな現状を打破する可能性を秘めた、LLM(大規模言語モデル)を活用した新しいフレームワークです。複雑なプログラミングや微調整を必要とせず、自然言語による指示だけでAIエージェントを訓練できるという、まさに「夢のような」技術。しかし、夢物語で終わらせないためには、その本質を理解し、日本のビジネス現場でどのように活用できるのかを具体的にイメージすることが重要です。

OpenClaw-RL:会話から生まれるAIエージェント

OpenClaw-RLを一言で表すなら、「LLMによるAIエージェントの民主化」でしょう。これまで、AIエージェントの構築には、専門的な知識と膨大なデータ、そして時間が必要でした。しかし、OpenClaw-RLは、自然言語での指示を理解し、それに基づいてエージェントが行動戦略を生成します。まるで、優秀な部下に「この資料をまとめて」と指示するような感覚で、AIエージェントを育成できるのです。

この技術の核心は、LLMの持つ「推論能力」と「汎用性」にあります。特定のタスクや環境に特化した学習データを大量に用意する必要がなく、幅広い分野で応用できるのが大きなメリットです。ロボットアームの制御、ゲームキャラクターの行動パターン生成、自動運転システムの開発など、可能性は無限大に広がります。

なぜ今、OpenClaw-RLが重要なのか?背景にあるビジネスニーズ

OpenClaw-RLが注目される背景には、深刻な人材不足と、変化の激しいビジネス環境があります。AI人材の獲得競争は激化の一途をたどり、AI技術の陳腐化も早まっています。そんな状況下で、OpenClaw-RLのような、より柔軟で迅速なAIエージェント開発手法は、企業にとって競争力を維持するための重要な武器となるでしょう。

特に、中小企業や地方企業にとっては、大きなチャンスです。潤沢な予算や専門チームがなくても、OpenClaw-RLを活用すれば、自社のビジネスに合わせたAIエージェントを開発し、業務効率化や新たな価値創造につなげることができます。例えば、地方の観光案内AIや、高齢者向けの生活支援ロボットなど、地域特有の課題解決に貢献するAIエージェントを、比較的容易に開発できる可能性があります。

9d9の現場感覚では、PoC(概念実証)止まりのAIプロジェクトの多くは、「データ準備の壁」にぶつかっています。OpenClaw-RLのように、データ依存度を下げられる技術は、AI活用の裾野を広げる起爆剤になると確信しています。

OpenClaw-RLの具体的な活用イメージと実装のポイント

OpenClaw-RLの可能性は理解できた。でも、実際にどう使えばいいの?ここからは、具体的な活用イメージと、実装における注意点について解説します。

まず、OpenClaw-RLを活用する上で重要なのは、「目的を明確にすること」です。どんな課題を解決したいのか?どんな価値を創造したいのか?を具体的に定義することで、OpenClaw-RLの潜在能力を最大限に引き出すことができます。例えば、以下のような活用事例が考えられます。

- **カスタマーサポートの自動化:** 顧客からの問い合わせに対し、OpenClaw-RLを搭載したチャットボットが自然な会話で対応。

- **製造現場での作業支援:** ロボットアームがOpenClaw-RLの指示に従い、複雑な組み立て作業や検査作業を自動化。

- **教育分野での個別指導:** OpenClaw-RLを活用したAIチューターが、生徒一人ひとりの理解度に合わせて、最適な学習プランを提供。

実装にあたっては、以下のポイントに注意しましょう。

- **LLMの選定:** OpenClaw-RLは様々なLLMに対応していますが、目的に合ったLLMを選ぶことが重要です。

- **指示の設計:** LLMに与える指示は、具体的かつ明確である必要があります。

- **フィードバックループの構築:** エージェントの行動を継続的に改善するため、環境からのフィードバックを適切に反映する仕組みを構築しましょう。

OpenClaw-RL導入におけるリスクと倫理的な課題

OpenClaw-RLは革新的な技術ですが、導入にあたってはリスクと倫理的な課題も考慮する必要があります。特に注意すべきは、以下の点です。

- **誤った指示による事故:** OpenClaw-RLは自然言語で指示を与えるため、誤解を招く指示や曖昧な指示を与えてしまう可能性があります。ロボットアームの誤作動や、自動運転システムの暴走など、重大な事故につながる可能性も否定できません。

- **データの偏りによるバイアス:** LLMは大量のデータから学習するため、学習データに偏りがあると、AIエージェントの行動にもバイアスが生じる可能性があります。例えば、特定の民族や性別に対する差別的な発言をするAIチャットボットなどが考えられます。

- **責任の所在の曖昧さ:** AIエージェントの行動によって損害が発生した場合、誰が責任を負うのか?OpenClaw-RLの開発者なのか?導入企業なのか?責任の所在が曖昧な場合、法的紛争に発展する可能性があります。

これらのリスクを軽減するためには、OpenClaw-RLの導入前に十分なリスクアセスメントを行い、倫理的なガイドラインを策定することが重要です。また、AIエージェントの行動を常に監視し、必要に応じて介入できる体制を整えることも大切です。

マーケターとして正直に言うと、AI技術の倫理的な問題は、ともすれば「触らぬ神に祟りなし」とばかりに、議論を避けてしまいがちです。しかし、技術の恩恵を最大限に享受するためには、倫理的な課題に真摯に向き合い、具体的な対策を講じることが不可欠だと考えています。

まとめ:OpenClaw-RLでAIエージェント開発の未来を切り開け

OpenClaw-RLは、AIエージェント開発のあり方を根本的に変える可能性を秘めた、非常に魅力的な技術です。中小企業や地方企業でも、自社のビジネスに合わせたAIエージェントを比較的容易に開発できるようになるでしょう。

もちろん、リスクや倫理的な課題も存在します。しかし、それらを十分に理解し、適切な対策を講じることで、OpenClaw-RLは企業の競争力強化、業務効率化、そして新たな価値創造に大きく貢献してくれるはずです。さあ、OpenClaw-RLで、AIエージェント開発の未来を切り開きましょう。

コメント