LLMの推論コスト、ボトルネックはどこに?

大規模言語モデル(LLM)を活用したAIサービス開発。PoCは成功したものの、いざ本番環境にデプロイしようとすると、推論コストが想定以上に高く、スケールアップに二の足を踏んでいませんか?特に、メモリ使用量の肥大化は、多くの企業が直面する共通の課題です。

LLMの推論処理において、ボトルネックとなるのは、主にGPUメモリです。巨大なモデルをロードするだけでなく、推論時に発生する中間データもメモリを圧迫します。特に、TransformerモデルにおけるAttention機構は、シーケンス長に対して二乗でメモリを消費するため、長文の処理や複雑なタスクにおいては、深刻な問題となります。

PagedAttention:仮想メモリの考え方をLLMへ

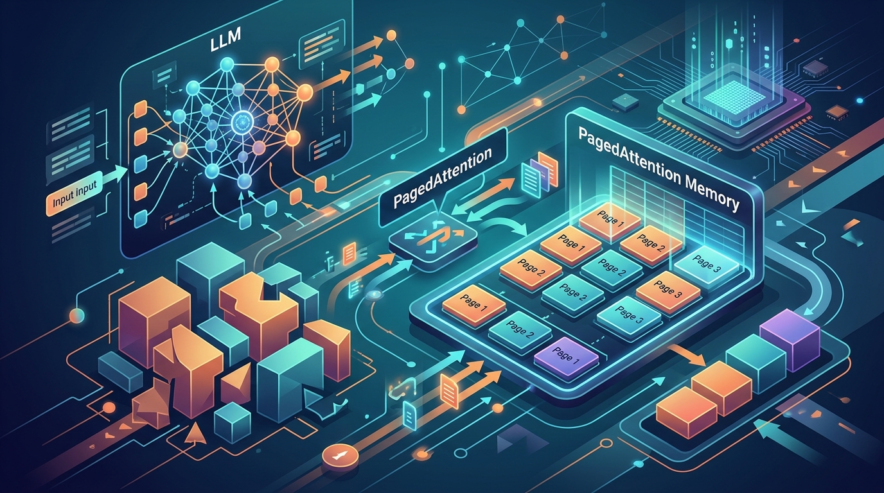

そんなメモリ課題を解決するかもしれない技術として注目されているのが「PagedAttention」です。この技術は、オペレーティングシステム(OS)における仮想メモリのページングという概念をLLM推論に応用したものです。

従来のLLMサービングでは、Attention計算に必要なキーと値のキャッシュを連続したメモリ領域に保存していました。そのため、バッチサイズやシーケンス長が変化するたびに、メモリの再配置が発生し、無駄が生じやすかったのです。

PagedAttentionでは、キーと値を固定サイズの「ページ」に分割し、不連続なメモリ領域に保存します。これにより、メモリの断片化を抑制し、効率的なメモリ利用を可能にします。必要なページだけをGPUメモリにロードすることで、メモリ使用量を大幅に削減できるのです。

PagedAttentionの仕組み:キーと値を「ページ」で管理する

PagedAttentionの核心は、Attentionのキーと値を「ページ」と呼ばれる固定サイズのブロックに分割して管理することです。各ページは、GPUメモリ上の不連続な場所に配置できます。

推論時に必要なページだけをロードし、不要なページはGPUメモリから退避させることで、メモリ使用量を最適化します。この仕組みにより、バッチサイズやシーケンス長が変動しても、柔軟に対応できます。

さらに、PagedAttentionは、仮想アドレス空間を利用して、ページ間のマッピングを管理します。これにより、物理的なメモリ配置に関わらず、連続したメモリ空間としてAttention計算を実行できます。あたかも巨大な一枚板のメモリがあるかのように錯覚できるわけです。

9d9の現場感覚では、PagedAttentionのような技術は、まさに「縁の下の力持ち」です。表面的には目立たないものの、AIサービスの安定稼働とコスト削減に大きく貢献します。特に、スループットとレイテンシのバランスが重要なリアルタイム応答系のAIサービスにおいては、その価値は計り知れません。

ビジネスへの応用:どんな課題を解決できるのか?

PagedAttentionの導入は、LLMを活用したビジネスにおいて、以下のような課題解決に貢献します。

- 推論コストの削減:GPUメモリ使用量の削減により、クラウド利用料やハードウェアコストを削減できます。

- スループットの向上:より大きなバッチサイズや長いシーケンス長を処理できるようになり、単位時間あたりの処理件数を増やせます。

- 大規模モデルの展開:メモリ容量の制約が緩和されるため、より大規模なモデルを少ないリソースで展開できます。

- リアルタイム応答性の向上:メモリ効率の向上により、レイテンシを短縮し、リアルタイムな応答性を実現できます。

例えば、カスタマーサポートチャットボットにおいては、PagedAttentionを導入することで、より多くの同時リクエストを処理できるようになり、顧客満足度向上に繋がるでしょう。また、金融分析においては、より長い期間のデータを分析できるようになり、より精度の高い予測モデルを構築できる可能性があります。

実装のヒント:既存のLLMフレームワークとの連携は?

PagedAttentionは、既存のLLMフレームワークとの連携も容易です。Hugging Face TransformersやPyTorchなどの主要なフレームワークでサポートされており、比較的簡単に導入できます。

ただし、パフォーマンスを最大限に引き出すためには、GPUメモリの最適化やページング戦略のチューニングが必要です。また、PagedAttentionは、すべてのLLMモデルに適用できるわけではありません。モデルのアーキテクチャやタスクの種類によっては、効果が限定的な場合もあります。

導入を検討する際は、事前に十分な検証を行い、自社のビジネス要件に最適な構成を見つけることが重要です。n8nのようなノーコードツールと組み合わせることで、PoCを迅速に進めることも可能です。

PagedAttentionの限界と、今後の展望

PagedAttentionは、LLM推論のメモリ効率を大幅に向上させる革新的な技術ですが、万能ではありません。例えば、小規模なモデルや短いシーケンス長の場合、オーバーヘッドが大きくなり、逆にパフォーマンスが低下する可能性があります。

また、PagedAttentionは、GPUメモリの利用効率を向上させる技術であり、計算量の削減には直接的には貢献しません。計算量の削減には、モデルの圧縮や量子化などの技術が必要となります。

しかし、LLMの進化は止まりません。今後、より大規模で複雑なモデルが登場するにつれて、PagedAttentionのようなメモリ効率化技術の重要性はますます高まるでしょう。将来的には、PagedAttentionがLLM推論の標準的な技術となり、あらゆるAIサービスで当たり前のように利用されるようになるかもしれません。

マーケターとして正直に言うと、PagedAttentionのような技術は、直接的に売上向上に貢献するものではありません。しかし、AIサービスの裏側を支え、長期的な競争力を高める上で、不可欠な存在です。一回のキャンペーンでKPIを達成するよりも、PagedAttentionのような技術を導入し、持続可能なAIインフラを構築することこそ、真のマーケティング投資だと考えています。

まとめ:PagedAttentionでLLMの可能性を広げよう

PagedAttentionは、LLM推論のメモリ効率を劇的に向上させる、非常に有望な技術です。推論コストの削減、スループットの向上、大規模モデルの展開など、多くのメリットをもたらします。

LLMを活用したAIサービス開発に取り組む企業にとって、PagedAttentionは、競争力を高めるための重要な選択肢となるでしょう。ぜひ、導入を検討してみてください。

コメント