AIの「公平性」という理想、その裏に潜む歪み

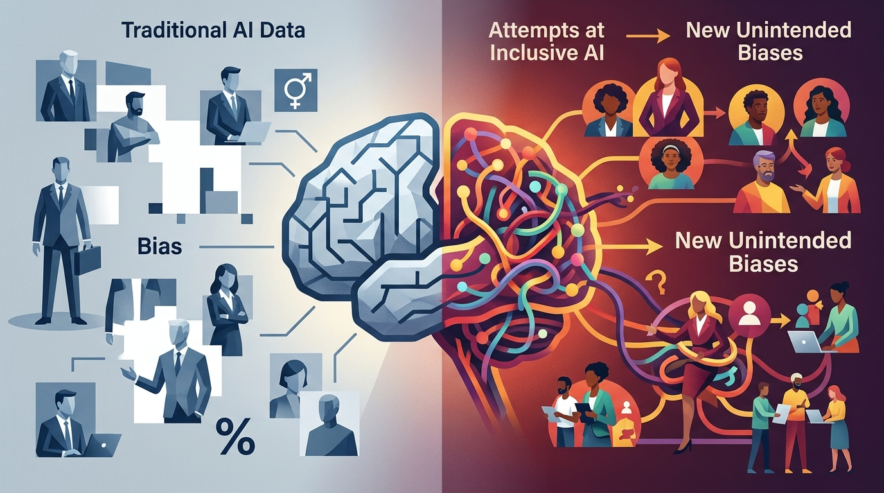

「AIに偏見はないはずだ」——そう信じたい気持ちは分かります。しかし現実には、学習データに潜む社会的なバイアスが、AIの判断に色濃く反映されることが知られています。ジェンダーバイアスはその代表例でしょう。女性よりも男性のデータを多く学習したAIは、特定の職業や役割を男性に結びつけやすくなります。では、この問題を解決するために、AIの「包容性」を高めれば良いのでしょうか?実は、そう単純な話ではないようです。

今回ご紹介する研究は、AIの包容性を高める試みが、意図せず新たなジェンダーバイアスを生み出す可能性があることを示唆しています。一体どういうことなのでしょうか?そして、私たちはこの問題にどう向き合うべきなのでしょうか?

「包容性」の追求が、なぜ新たなバイアスを生むのか?

AIのジェンダーバイアスを軽減するために、研究者たちは様々なアプローチを試みてきました。例えば、学習データにおける男女比の偏りを修正したり、AIモデル自体にバイアスを軽減するような仕組みを組み込んだりするなどです。しかし、これらの試みが、必ずしも期待通りの結果をもたらさないことが分かってきました。

今回の研究では、AIがデータに基づいて学習する際に、既存の社会的なジェンダーの固定観念を「増幅」させてしまう可能性が指摘されています。つまり、表面的な男女比の調整だけでは、根深いバイアスを解消することはできないということです。むしろ、安易な修正は、AIに新たな歪んだ認識を植え付けてしまう危険性すらあります。

データ偏見は、社会の写し鏡

AIが学習するデータは、私たちの社会の写し鏡です。歴史的な背景、文化的な価値観、そして日々の生活の中で無意識に抱いている偏見などが、データの中に複雑に織り込まれています。そのため、データからジェンダーバイアスを取り除くことは、単に数字を調整するだけの問題ではありません。社会全体でジェンダーに関する意識改革を進め、データそのものをより公平で包括的なものにしていく必要があります。

9d9の現場感覚では、データの前処理にばかり注目が集まりがちですが、そもそも「何のデータを集めるか」という段階からバイアスは入り込んでいます。例えば、顧客データを分析する際、過去の成功事例に偏ってデータを集めてしまうと、新しい顧客層の開拓を妨げる可能性があります。データを集める目的を明確にし、多様な視点を取り入れることが重要です。

「説明可能なAI」というアプローチ

AIの判断プロセスをブラックボックスのままにしておくと、バイアスがどのように作用しているのかを把握することができません。そこで注目されているのが、「説明可能なAI(Explainable AI: XAI)」というアプローチです。これは、AIがなぜそのような判断を下したのかを人間が理解できるようにする技術です。

説明可能なAIを活用することで、AIの判断におけるバイアスの存在を検出し、その原因を特定することができます。また、AIの判断根拠を可視化することで、人間はAIの誤りを修正し、より公平な判断を促すことができます。

AI倫理の議論は、経営戦略そのもの

AIの倫理に関する議論は、もはや単なる技術的な課題ではありません。企業のブランドイメージ、顧客からの信頼、そして長期的な成長戦略に深く関わる重要な経営課題です。AIを活用する企業は、倫理的な観点からAIの設計、開発、運用を見直し、ステークホルダーとの対話を積極的に進める必要があります。

AIの倫理ガイドラインを策定したり、倫理委員会を設置したりすることも有効でしょう。また、AIに関する社員研修を実施し、倫理的な意識を高めることも重要です。AIは強力なツールですが、その使い方を誤れば、社会に大きな負の影響を与える可能性があります。企業は、AIの倫理的な責任を真摯に受け止め、持続可能な社会の実現に貢献していく必要があります。

小さく試す、アジャイルなバイアス対策

「完璧なバイアス対策」は存在しません。なぜなら、バイアスは常に変化し、進化するからです。重要なのは、一度対策を講じて終わりにするのではなく、継続的にモニタリングと改善を繰り返していくことです。

アジャイル開発の考え方を取り入れ、小さく試して、その結果を迅速にフィードバックループに反映させていくことが有効です。例えば、特定のターゲット層に対してAIを活用したマーケティングキャンペーンを実施する際に、バイアスの影響を評価するためのA/Bテストを行うことができます。その結果を分析し、必要に応じてAIモデルやキャンペーン戦略を修正していくことで、徐々にバイアスを軽減していくことができます。

わたしがクライアント支援で実感するのは、完璧なシステムを最初から作ろうとすると、どうしてもコストと時間がかかりすぎてしまうことです。まずは、手動でできる範囲でバイアスチェックのプロセスを組み込み、徐々にAIによる自動化を進めていくのが現実的でしょう。n8nのようなローコードツールを活用すれば、比較的簡単に自動化のプロトタイプを作成できます。

まとめ:AIと人間の協調による、より良い未来へ

AIの包容性を高める試みが、意図せず新たなジェンダーバイアスを生み出す可能性があるという今回の研究は、AI開発における倫理的な課題の複雑さを浮き彫りにしています。データ偏見、説明可能性、アジャイルな改善という3つの視点から、AIと人間が協調し、より公平で包括的な未来を築いていくためのヒントを探りました。AIはあくまでツールであり、その使い方を決定するのは私たち人間です。AIの可能性を最大限に引き出すためには、倫理的な観点から常に問い続け、改善を繰り返していく姿勢が不可欠です。

コメント