AIは、人を殺すべきか?

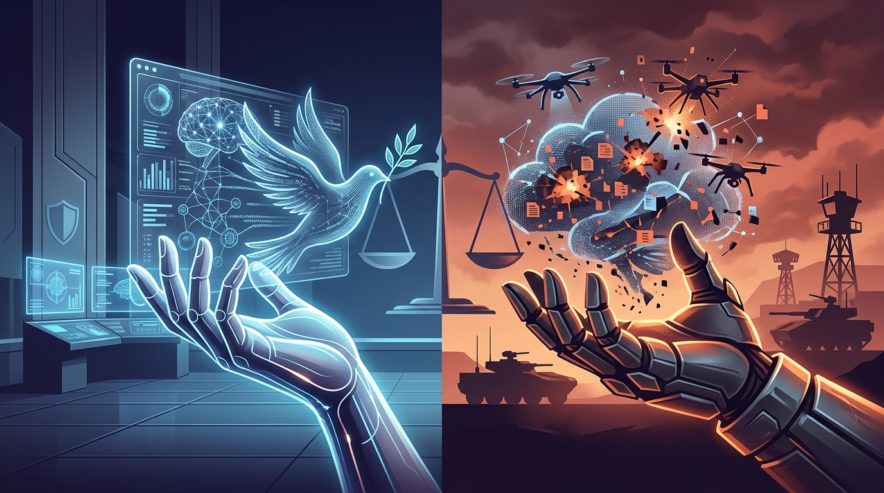

もし、AIが搭載されたドローンが、あなたを敵と認識したら? それは誤認識かもしれない。AIは完璧ではない。でも、その判断が覆されることはないかもしれない。軍事利用が進むAI技術の倫理的な問題は、技術の進化に追いついていないのが現状です。今回は、アメリカ国防総省のAIプログラム「プロジェクト・メイブン」を題材に、AI倫理の核心に迫ります。

プロジェクト・メイブンとは何か?

プロジェクト・メイブンは、ドローン映像などの大量のデータをAIによって解析し、標的の特定や追跡を支援するプログラムです。これにより、人間の分析官はより迅速かつ効率的に情報処理を行うことができるようになります。しかし、その効率化の裏には、AIの判断が戦争の意思決定に与える影響という、重い倫理的な問題が潜んでいます。

なぜ今、軍事AIの倫理が重要なのか?

AI技術の進化は、軍事分野においても革新をもたらしています。しかし、AIが人間の命に関わる判断を行うことは、倫理的に大きな問題を提起します。AIの判断は、アルゴリズムに組み込まれた偏見や誤りによって歪められる可能性があります。また、AIが自律的に判断を下すようになれば、人間のコントロールが及ばなくなるリスクも存在します。これらの問題は、単なる技術的な課題ではなく、社会全体で議論し、解決策を見出すべき課題です。

AIは誰の責任なのか?

AIが誤った判断を下した場合、誰が責任を負うのでしょうか? 開発者、運用者、それともAI自身でしょうか? 現在の法制度では、AIの責任を明確に定義することは困難です。AIが自律的に行動するようになれば、責任の所在はさらに曖昧になります。この問題を解決するためには、AIの開発段階から倫理的な配慮を行い、責任の所在を明確にするための法制度を整備する必要があります。

9d9の現場感覚では、AI導入における責任範囲の不明確さが、多くの企業がAI導入を躊躇する理由の一つだと感じています。特に、クリエイティブ領域では、AI生成物の著作権問題が顕在化しており、法整備の遅れがビジネスの足枷となっています。

日本企業が軍事AIから学ぶべきこと

軍事AIの倫理問題は、軍事分野に限った話ではありません。AI技術をビジネスに活用する上でも、同様の倫理的な問題が発生する可能性があります。例えば、採用活動におけるAIの利用は、潜在的な偏見を含む可能性があります。顧客対応におけるAIチャットボットの利用は、プライバシーの問題を引き起こす可能性があります。日本企業は、軍事AIの倫理問題を教訓に、AI技術の倫理的な利用に関するガイドラインを策定し、従業員の倫理意識を高める必要があります。

AI倫理の未来:私たちにできること

AI倫理の問題は、技術者だけでなく、社会全体で取り組むべき課題です。私たちは、AI技術の進化を注視し、その倫理的な影響について議論する必要があります。また、AIに関する知識を深め、AI技術の恩恵を最大限に享受しつつ、そのリスクを最小限に抑えるための努力が必要です。AIは道具であり、使い方次第で善にも悪にもなります。私たち一人ひとりが、AI倫理について真剣に考えることが、AIの未来をより良いものにするための第一歩です。

わたしがクライアント支援で実感するのは、AI導入時に「何ができるか」にばかり目が行きがちで、「何をすべきでないか」という倫理的な視点が欠落しているケースが多いということです。特に、中小企業では、リソース不足から倫理的な検討がおざなりになりがちですが、長期的な視点で見れば、倫理的な配慮は企業価値を高める上で不可欠です。

まとめ

プロジェクト・メイブンをきっかけに、軍事AIの倫理的な側面を見てきました。AI技術は、社会に大きな変革をもたらす可能性を秘めていますが、その利用には慎重な検討が必要です。AI倫理は、私たち一人ひとりが真剣に向き合うべき課題であり、その議論を通じて、より良い未来を築き上げていく必要があります。

コメント