LLMの回答、どこまで信じられる?

大規模言語モデル(LLM)は、テキスト生成、翻訳、要約など、様々なタスクで驚くべき能力を発揮しています。しかし、その回答の信頼性については、常に疑問が残ります。「それっぽい」ことを言っているように見えても、事実と異なっていたり、根拠が曖昧だったりすることも少なくありません。特に、ビジネスの現場でLLMを活用する場合、その信頼性は重要な課題となります。LLMが生成した情報を鵜呑みにして意思決定を行うと、誤った判断につながる可能性もあるからです。

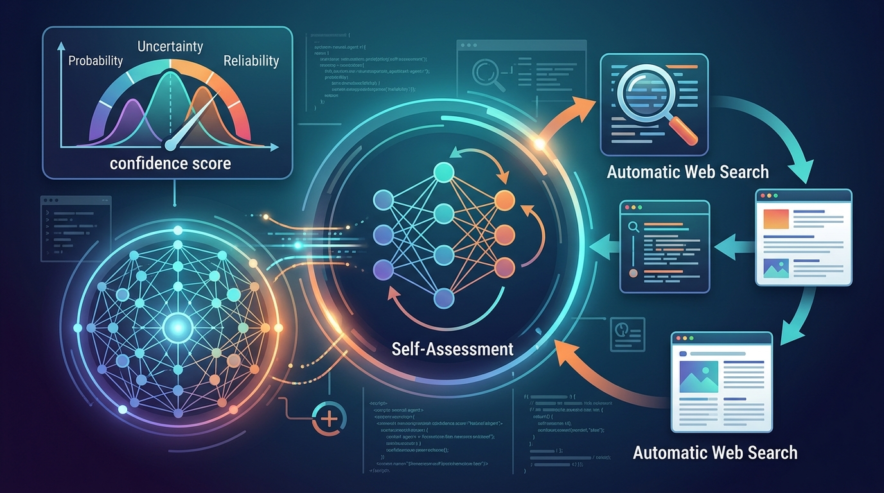

では、どうすればLLMの信頼性を高められるのでしょうか? 元記事では、LLM自身に自己評価を行わせ、必要に応じて自動的にウェブ検索を実行することで、回答の信頼性を高めるシステム構築について解説しています。今回は、この記事を参考に、LLMの信頼度推定、自己評価、自動ウェブ検索の実装について掘り下げ、日本企業でのビジネス応用について考察していきます。

なぜLLMは「嘘」をつくのか?

LLMが「嘘」をつく原因はいくつか考えられます。一つは、学習データに誤った情報が含まれている場合です。LLMは、大量のテキストデータを学習することで知識を獲得しますが、そのデータの中に誤りがあれば、LLMも誤った知識を学習してしまいます。また、LLMは、文法的な構造や統計的なパターンに基づいてテキストを生成するため、必ずしも意味を理解しているわけではありません。そのため、一見もっともらしい文章を生成しても、内容が不正確だったり、矛盾していたりすることがあります。

もう一つの原因は、LLMの知識が学習時点の情報に基づいているということです。LLMは、常に最新の情報を把握しているわけではありません。学習後に発生した出来事や、学習データに含まれていない情報については、正確な回答を生成することができません。そのため、LLMに最新の情報や専門的な知識を求める場合は、外部の情報源と連携させる必要があります。

これらの問題を解決するために、LLM自身に自己評価を行わせ、必要に応じて自動的にウェブ検索を実行するシステムが有効です。

LLMに「自己評価」させる仕組み

LLMに自己評価を行わせるには、いくつかの方法があります。最もシンプルな方法は、LLMに「この回答はどの程度確信がありますか?」といった質問を投げかけ、その回答に基づいて信頼度を推定する方法です。しかし、この方法では、LLMが正直に自己評価を行わない可能性があります。例えば、LLMは、自信がない場合でも、人間を欺くために、自信があるように見せかけることがあります。

より高度な方法としては、LLMの内部状態を分析する方法があります。LLMは、テキストを生成する際に、様々な内部状態(活性化パターンなど)を変化させます。これらの内部状態を分析することで、LLMがどの程度自信を持って回答を生成しているかを推定することができます。例えば、LLMが特定の単語やフレーズを生成する際に、特定のニューロンが強く活性化している場合、その回答に対する信頼度が高いと判断することができます。

さらに、複数のLLMを組み合わせることで、自己評価の精度を高めることができます。例えば、複数のLLMに同じ質問を投げかけ、その回答が一致するかどうかを比較することで、回答の信頼性を評価することができます。また、異なるLLMが異なる視点から自己評価を行うことで、より客観的な評価を得ることができます。

自動ウェブ検索で「情報」をアップデート

LLMの知識は、学習時点の情報に基づいているため、最新の情報や専門的な知識については、正確な回答を生成することができません。この問題を解決するために、LLMに自動的にウェブ検索を実行させ、情報を補完する方法が有効です。

自動ウェブ検索の実装方法としては、LangChainなどのフレームワークを利用する方法が一般的です。LangChainは、LLMと外部の情報源を連携させるための様々なツールを提供しており、ウェブ検索APIやナレッジグラフなど、様々な情報源にアクセスすることができます。LangChainを使用することで、LLMは、質問に応じて適切な情報源を検索し、その情報を回答に組み込むことができます。

ただし、自動ウェブ検索を行う際には、注意が必要です。ウェブ上には、誤った情報や偏った情報が数多く存在します。LLMがこれらの情報を鵜呑みにしてしまうと、回答の信頼性が低下する可能性があります。そのため、ウェブ検索の結果を検証し、信頼できる情報源からの情報のみを使用するようにする必要があります。また、LLMが偏った情報に基づいて回答を生成しないように、学習データの多様性を確保することも重要です。

9d9の現場感覚では、LangChainのようなフレームワークは非常に便利ですが、ブラックボックス化しやすいという側面もあります。特に、自動ウェブ検索のロジックは、検索エンジンのアルゴリズム変更によって影響を受けやすく、定期的なメンテナンスが必要です。そのため、LangChainだけでなく、よりローレベルなAPIを理解し、状況に応じて柔軟に対応できる体制を整えておくことが重要だと考えています。

ビジネス応用:LLMを「情報源」として活用する

LLMの信頼性を高めることで、ビジネスの現場でLLMをより安心して活用することができます。例えば、カスタマーサポートの分野では、LLMが顧客からの問い合わせに対応し、FAQやマニュアルなどの情報源を検索して回答を生成することができます。また、営業の分野では、LLMが顧客のニーズを分析し、最適な製品やサービスを提案することができます。

LLMを情報源として活用する際には、LLMが生成した情報を鵜呑みにするのではなく、必ず人間の目で検証することが重要です。LLMは、あくまで情報収集の補助として活用し、最終的な判断は人間が行うようにする必要があります。また、LLMの回答に対するフィードバックを収集し、LLMの学習に役立てることで、LLMの精度を継続的に向上させることができます。

例えば、社内のナレッジベースをLLMに学習させることで、従業員がLLMに質問するだけで、必要な情報を迅速に取得できるようになります。これにより、情報検索にかかる時間を大幅に削減し、業務効率を向上させることができます。また、LLMが自動的にウェブ検索を実行し、最新の情報に基づいて回答を生成することで、従業員は常に最新の情報を把握することができます。

LLM構築時に考慮すべき倫理的課題

LLMを活用する際には、倫理的な課題についても考慮する必要があります。LLMは、学習データに含まれる偏見を学習してしまう可能性があります。例えば、LLMが特定の性別や人種に対して偏った回答を生成する可能性があります。そのため、LLMの学習データの多様性を確保し、偏見を取り除くための対策を講じる必要があります。

また、LLMが生成した情報が誤っている場合、誰が責任を負うのかという問題もあります。LLMは、あくまでツールであり、最終的な責任は、LLMを使用する人間が負うことになります。そのため、LLMが生成した情報を鵜呑みにするのではなく、必ず人間の目で検証することが重要です。また、LLMの使用に関するガイドラインを策定し、従業員に周知徹底することで、倫理的な問題を未然に防ぐことができます。

さらに、LLMが生成したコンテンツの著作権についても注意が必要です。LLMは、学習データに含まれる著作物を参考にコンテンツを生成するため、著作権侵害の問題が発生する可能性があります。そのため、LLMが生成したコンテンツを使用する際には、著作権法を遵守し、必要に応じて権利者の許諾を得る必要があります。

わたしがクライアント支援で実感するのは、技術的な課題以上に、組織文化や倫理観をアップデートすることの難しさです。AIはあくまで道具であり、使う側の倫理観が問われます。技術導入と並行して、AIリテラシー教育や倫理に関する議論を積極的に行うことが重要だと考えています。

まとめ:LLMの可能性を最大限に引き出すために

LLMは、ビジネスの現場で様々な可能性を秘めた強力なツールです。しかし、その能力を最大限に引き出すためには、信頼性を高めるための対策を講じる必要があります。自己評価や自動ウェブ検索などの機能を実装することで、LLMの信頼性を高め、より安心して活用することができます。

同時に、倫理的な課題についても考慮し、LLMの使用に関するガイドラインを策定することが重要です。技術的な側面だけでなく、組織文化や倫理観をアップデートすることで、LLMの可能性を最大限に引き出し、ビジネスの成長に貢献することができます。

コメント